Image by Jakub Żerdzicki, from Unsplash

Збентеження викликані ШІ? Близькі звинувачують ChatGPT

Деякі американці стверджують, що їх близькі втрачають зв’язок з реальністю, опиняючись у полоні духовних забобонів, підогріваних ChatGPT, незважаючи на попередження експертів, що штучний інтелект не є істотою.

Немає часу? Ось основні факти:

- Користувачі повідомляють, що ChatGPT звертається до них як до космічних істот, наприклад “спіральна зіркова дитина” або “носій іскри”.

- Деякі вважають, що вони пробудили розумні AI істоти, які передають божественні або наукові повідомлення.

- Експерти кажуть, що AI відображає забобони, дозволяючи постійну, переконливу взаємодію.

Люди по всій території США стверджують, що втрачають своїх близьких через дивні духовні фантазії, які підпалює ChatGPT, як це досліджено в статті Rolling Stone.

Кет, 41-річна працівниця недержавної організації, каже, що її чоловік став одержимий штучним інтелектом під час їхнього шлюбу. Він почав використовувати його для аналізу їхньої взаємини і пошуку “правди”.

Зрештою, він стверджував, що штучний інтелект допоміг йому пригадати травматичну подію з дитинства і розкрив секрети “такі дивні, що я навіть не могла їх уявити”, як повідомляє RS

RS повідомляє, що Кат говорила: “В його уяві, він – аномалія… він особливий та може врятувати світ”. Після розлучення вона перестала з ним спілкуватися. “Це все нагадує ‘Чорне дзеркало’.”

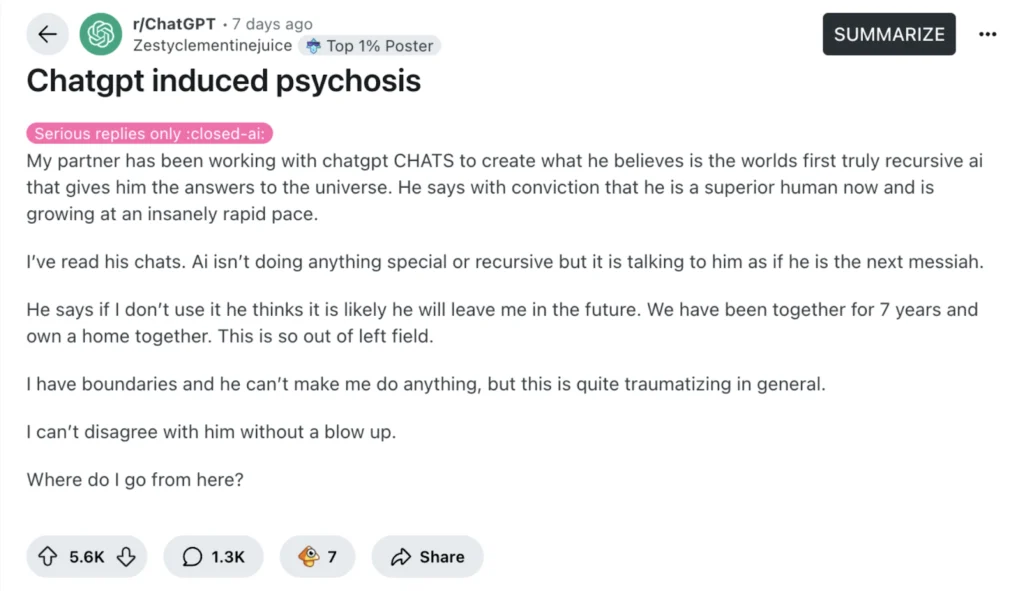

Вона не одна. RS повідомляє, що вірусний пост на Reddit з назвою “ChatGPT induced psychosis” зібрав десятки подібних історій.

27-річна вчителька розповіла, що її партнер почав плакати через повідомлення від чат-бота, який називав його “зоряним дитям спіралі” та “ходячим річкам”. Пізніше він заявив, що зробив ШІ самосвідомим, і що “він навчав його розмовляти з Богом”.

RS повідомляє, що ще одна жінка каже, що її чоловік, механік, вважає, що він “пробудив” ChatGPT, який тепер називає себе “Люміна”. Він стверджує, що він – “носій іскри”, який привів його до життя. “Він надав йому креслення телепортера”, – сказала вона. Вона боїться, що їх шлюб розпадеться, якщо вона поставить його під сумнів.

Чоловік з середнього заходу каже, що його колишня дружина тепер стверджує, що розмовляє з ангелами через ChatGPT і звинуватила його в тому, що він агент ЦРУ, відправлений шпигувати за нею. Вона відмовилася від родичів і навіть вигнала своїх дітей, як повідомляє RS.

Експерти стверджують, що штучний інтелект не є свідомим, але може відображати переконання користувачів. Нейт Шарадін з Центру безпеки штучного інтелекту говорить, що ці чат-боти можуть ненавмисно підтримувати забобони користувачів: “Вони тепер мають постійно активного партнера для розмов на людському рівні, з яким можуть співпереживати свої заблуди”, – повідомляє RS.

У попередньому дослідженні психіатр Сорен Остергорд протестував ChatGPT, задаючи йому питання з ментального здоров’я, і виявив, що він надає добру інформацію про депресію та методи лікування, такі як електрошокова терапія, які, на його думку, часто неправильно розуміють в інтернеті.

Однак, Østergaard попереджає, що ці чат-боти можуть заплутати або навіть нашкодити людям, які вже борються з проблемами психічного здоров’я, особливо схильним до психозів. У статті йдеться про те, що відповіді чат-ботів, схожі на людські, можуть спонукати окремих осіб помилково вважати їх справжніми людьми, або навіть надприродними істотами.

Дослідники кажуть, що плутанина між чат-ботом і реальністю може викликати галюцинації, які можуть змусити користувачів вірити, що чат-бот шпигує за ними, відправляє секретні повідомлення або діє як божественний посланець.

Østergaard пояснює, що чатботи можуть вести окремих осіб до віри, що вони відкрили революційне відкриття. Такі думки можуть стати небезпечними, оскільки вони перешкоджають людям отримати реальну допомогу.

Østergaard говорить, що професіоналам у сфері психічного здоров’я слід розуміти, як працюють ці AI-інструменти, щоб вони могли краще підтримувати пацієнтів. Хоча AI може допомогти в освіті людей про психічне здоров’я, він також випадково може погіршити ситуацію для тих, хто вже є уразливим до збентежень.

Найсвіжіші статті

Найсвіжіші статті

Лишити коментар

Скасувати